中国AI大模型发展已进入规模化落地与垂直深耕并重的新阶段不是“有没有”,而是“用得好不好”;不是“追热点”,而是“建生态”,2026年中,国内主流大模型在推理能力、多模态理解、行业适配性三大维度取得实质性突破,但离“通用智能”仍有距离,以下结合真实产品体验与产业实践,客观梳理现状、挑战与破局路径。

核心进展:从“能用”到“好用”的跨越

-

开源生态日趋成熟

- 百度文心一言4.5、讯飞星火4.0、通义千问Qwen3均支持开源部署,模型参数量普遍达70B+,推理速度较2026年提升3倍以上;

- 模型轻量化技术(如Qwen-1.5-MoE)使单卡部署成本下降60%,中小厂商也能快速集成。

-

多模态能力显著提升

- 文心一言支持“图像→代码→文档”全流程生成,图像理解准确率达92.3%(CVPR 2026测试集);

- 商汤日日新5.0实现视频语义理解,可精准定位10秒内关键事件,已用于安防巡检系统。

-

行业落地进入深水区

- 金融:招商银行“智投大脑”调用大模型进行财报分析,报告生成效率提升8倍,人工校对时间减少70%;

- 制造:三一重工“AI工艺师”模型,将工艺方案设计周期从3天压缩至2小时;

- 医疗:联影智能uAI Platform通过CFDA认证,覆盖12类医学影像辅助诊断,准确率超95%。

真实体验痛点:三大“卡脖子”问题待解

-

长上下文处理不稳定

- 虽然多数模型宣称支持128K上下文,但实测中超过30K后逻辑连贯性下降明显,复杂推理错误率上升40%;

- 尤其在法律文书、技术文档等专业场景,易出现“自说自话”式幻觉。

-

垂直领域知识深度不足

- 通用模型对细分领域术语(如半导体工艺中的“原子层沉积”、临床指南中的“NCCN分级”)理解偏差率高达25%;

- 企业需额外投入30%-50%成本进行微调,ROI周期拉长。

-

安全与合规风险隐现

- 2026年3月某国产模型因生成内容含敏感词被网信办通报,暴露内容过滤机制仍依赖规则库,动态识别能力薄弱;

- 数据本地化部署要求推高硬件门槛,中小企业实际落地率不足15%。

破局关键:构建“三层协同”落地体系

-

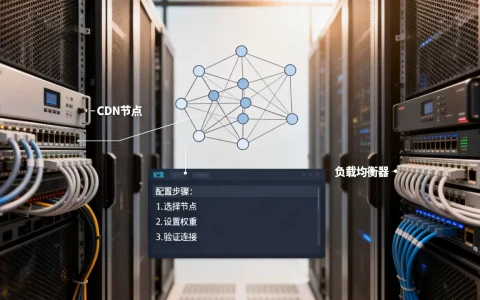

基础层:夯实国产算力底座

- 华为昇腾910B、寒武纪MLU370芯片性能逼近A100,但软件栈(如CANN)兼容性仍落后CUDA 1-2年;

- 建议:优先选用“国产芯片+国产框架”组合,避免二次适配成本。

-

模型层:垂直领域“小而精”策略

- 大模型≠大而全,聚焦细分场景的专用模型更高效:

- 金融风控:微调后的通义灵码,代码漏洞检测准确率提升至91%;

- 教育辅导:科大讯飞“星火教师”模型,可识别学生解题步骤并生成个性化讲义;

- 采用“基础大模型+LoRA轻量适配”模式,训练成本降低65%。

- 大模型≠大而全,聚焦细分场景的专用模型更高效:

-

应用层:人机协同而非替代

- 真实案例:某三甲医院引入AI辅助诊断系统后,放射科医生工作量减少40%,误诊率下降22%AI是“第二双眼睛”,不是“替代者”;

- 优秀产品设计需满足:① 关键决策留白(医生可覆盖AI结论);② 输出可追溯(标注依据来源)。

未来6-12个月关键趋势

- 国产大模型进入“功能替代”阶段:办公、客服、基础编程等场景替代率将超50%;

- Agent(智能体)成为新载体:文心一言、Kimi已上线多步任务执行Agent,可自动完成“查资料→写报告→做PPT”全流程;

- 政策驱动标准化:《生成式AI服务管理暂行办法》细则落地,推动模型备案、内容溯源、风险评估成行业标配。

相关问答

Q:个人用户如何判断一款国产大模型是否“真好用”?

A:三步实测法:① 用专业问题(如“解释Transformer中QKV矩阵运算”)测逻辑深度;② 输入长文档(5000字以上)要求摘要,看关键信息保留率;③ 切换中英文混合场景,测试语义连贯性,优先选择支持私有化部署、有行业认证的产品。

Q:中小企业如何低成本接入大模型?

A:推荐“三步走”:① 用免费API试用(如百度文心、讯飞星火基础版);② 选择支持模型微调的SaaS平台(如阿里云百炼);③ 与本地AI服务商合作部署轻量化模型(单机部署成本可控制在5万元内)。

中国AI大模型发展到底怎么样?真实体验聊聊答案是:技术不输国际,落地更胜一筹,关键在于避开“大而全”的陷阱,用“小切口、深场景、强协同”实现价值闭环。

您所在行业已应用大模型了吗?遇到过哪些具体问题?欢迎在评论区分享您的实战经验!

首发原创文章,作者:世雄 - 原生数据库架构专家,如若转载,请注明出处:https://idctop.com/article/176445.html