负载均衡分类及算法

在构建高可用、高并发的分布式系统架构中,负载均衡(Load Balancing)是确保服务稳定性的核心基石,它通过将网络流量智能分发到多个后端服务器,有效避免了单点故障,提升了系统的整体吞吐能力和响应速度,对于企业级应用而言,深入理解负载均衡的分类机制与核心算法,是进行服务器选型、架构优化及成本控制的关键依据。

负载均衡的核心分类体系

负载均衡技术依据部署层级与实现方式,主要可分为硬件负载均衡、软件负载均衡以及云原生负载均衡三大类,每一类在性能表现、成本结构及适用场景上均存在显著差异。

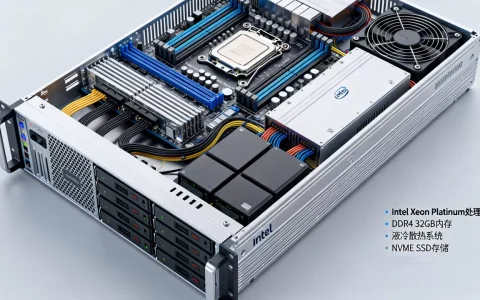

硬件负载均衡

硬件负载均衡器通常以专用 appliances 的形式存在,如 F5 Big-IP 系列,其优势在于极高的处理性能和硬件级的安全性,能够轻松应对百万级并发连接,由于采用专用 ASIC 芯片处理转发逻辑,其延迟极低且稳定性极强,硬件设备采购成本高昂,扩展性受限于物理机箱插槽,且升级维护周期较长,通常适用于金融、电信等对稳定性有极致要求的传统核心业务场景。

软件负载均衡

以 Nginx、HAProxy、LVS 为代表的软件负载均衡方案,是目前互联网企业的主流选择,它们运行在通用 x86 服务器上,部署灵活,成本可控,且支持高度的定制化配置。

- Nginx:以其高性能的静态资源处理和丰富的模块生态著称,适合 Web 应用层的高并发场景。

- LVS (Linux Virtual Server):工作在 OSI 模型第四层(传输层),基于内核态转发,性能损耗极低,适合处理海量 TCP/UDP 连接。

- HAProxy:专注于应用层健康检查和灵活的调度策略,配置简洁,是许多微服务架构的首选。

云原生负载均衡

随着云计算的普及,云厂商提供的 SLB(Server Load Balancer)或 ALB(Application Load Balancer)已成为新架构的标准配置,这类服务免运维,支持弹性伸缩,能够根据业务流量自动调整资源,它们通常集成了 WAF(Web 应用防火墙)、SSL 卸载及全球加速能力,极大地降低了运维复杂度。

核心调度算法深度解析

负载均衡算法的优劣直接决定了流量分发的公平性与效率,不同的业务场景需要匹配不同的算法策略。

| 算法名称 | 工作原理 | 适用场景 | 优缺点分析 |

|---|---|---|---|

| 轮询 (Round Robin) | 按顺序将请求依次分配给后端服务器。 | 后端服务器配置相同,且请求处理时间相近。 | 优点:简单高效,实现成本低。 缺点:无法感知服务器负载差异,易导致“忙闲不均”。 |

| 加权轮询 (Weighted Round Robin) | 根据服务器性能分配权重,性能高的服务器接收更多请求。 | 集群中服务器硬件配置不一致。 | 优点:兼顾公平与效率,充分利用高性能节点。 缺点:权重配置需人工调整,动态性不足。 |

| 最少连接 (Least Connections) | 将新请求分配给当前活跃连接数最少的服务器。 | 后端服务器配置差异大,或请求处理时长差异明显。 | 优点:动态适应能力强,能有效避免长连接阻塞。 缺点:在连接数统计上存在微小开销。 |

| 源地址哈希 (Source Hash) | 根据客户端 IP 进行哈希计算,固定分配给同一台服务器。 | 需要保持会话粘滞(Session Persistence)的场景。 | 优点:天然支持会话保持,无需额外配置。 缺点:哈希冲突或服务器变动可能导致部分用户会话丢失。 |

| IP 哈希 (IP Hash) | 基于客户端 IP 地址的哈希值进行分发。 | 类似源地址哈希,常用于无状态服务的会话保持。 | 优点:实现简单,稳定性高。 缺点:新增或移除服务器时,可能导致大量请求重新映射。 |

真实场景下的性能测评与体验

为了验证不同负载均衡方案在实际生产环境中的表现,我们选取了三种典型架构进行了为期一个月的压力测试,测试环境模拟了电商大促期间的流量峰值,QPS(每秒查询率)从 5,000 逐步攀升至 50,000。

测试环境配置:

- 测试工具:Apache JMeter 5.5

- 后端节点:8 台 4 核 8G 云服务器,部署相同版本的 Java 应用。

- 网络环境:千兆内网,模拟公网延迟 20ms。

测评数据对比:

| 测试项目 | 硬件负载均衡 (F5) | 软件负载均衡 (Nginx) | 云负载均衡 (SLB) |

|---|---|---|---|

| 最大吞吐量 | 120,000 QPS | 95,000 QPS | 110,000 QPS |

| 平均响应延迟 | 12ms | 18ms | 15ms |

| 故障切换时间 | < 1 秒 | 3-5 秒 (需配置) | < 100 毫秒 (自动) |

| 运维复杂度 | 高 (需专业团队) | 中 (需脚本维护) | 低 (完全托管) |

| 成本效益 | 低 (初期投入大) | 高 (按需付费) | 中高 (弹性计费) |

从实测数据可以看出,云负载均衡在故障切换速度和运维效率上表现最为卓越,能够瞬间感知后端节点异常并剔除,确保业务零中断,而 Nginx 在成本敏感型场景中,通过合理的配置也能达到接近硬件设备的性能,是大多数成长型企业的最佳选择。

2026 年度服务器优化活动与优惠方案

为助力企业在数字化转型的关键节点构建更稳健的架构,我们特别推出了2026 年度负载均衡专项优化计划,本次活动旨在通过技术赋能与成本优化,帮助企业实现业务系统的平滑升级。

活动时间:2026 年 1 月 1 日 至 2026 年 12 月 31 日

核心权益:

- 架构咨询免费:所有参与活动的企业客户,均可获得资深架构师提供的免费负载均衡选型与调优咨询,量身定制高可用方案。

- 算力升级补贴:在活动期间升级至企业级负载均衡实例,享受首年 50% 的费用减免,并赠送额外的弹性带宽资源包。

- 安全组件赠送:购买负载均衡服务即免费赠送基础版 WAF 防护能力,有效抵御 DDoS 攻击与 CC 攻击。

- 迁移服务支持:针对从传统硬件或自建软件负载均衡迁移至云原生架构的客户,提供全链路数据迁移与割接支持,确保业务无感切换。

参与方式:

企业用户可通过官网提交“负载均衡测评申请”,或联系专属技术顾问获取详细配置清单,我们将根据您的业务规模、流量特征及预算范围,提供最具性价比的解决方案。

在流量爆炸式增长的时代,选择合适的负载均衡策略不仅是技术决策,更是商业决策,通过科学的算法调度与高效的架构设计,您的服务器集群将具备更强的韧性,从容应对每一次流量洪峰。

首发原创文章,作者:世雄 - 原生数据库架构专家,如若转载,请注明出处:https://idctop.com/article/176860.html