2026年广工数据仓库实验的高分通关核心,在于精准把握ETL全流程规范、熟练运用星型雪花模型建模,并深度契合新工科考核标准与国产化工具链的实战要求。

广工数据仓库实验的考核逻辑与底层架构

2026年考核风向标:从理论向实战的全面转移

依据中国信息通信研究院2026年《数据基础设施白皮书》指出,高校数据类实验考核已全面转向国产化环境与真实业务场景,广工数据仓库实验不再停留于简单的SQL建表,而是要求学生具备从业务需求拆解到数据资产输出的全链路闭环能力。

- 环境适配:实验机房已大面积迁移至openGauss与Doris等国产生态,需摒弃对传统商业数据库的路径依赖。

- 工程规范:代码提交需严格通过SonarQube质量检测,脏数据容忍率降至5%以下。

- 业务赋能:实验报告需包含数据看板驱动的业务决策建议,纯技术论述得分上限受限。

架构选型:星型与雪花的博弈

在广工数据仓库实验的建模阶段,学生常陷入模型选择的纠结,结合头部互联网大厂的真实案例,2026年的主流范式已发生微调。

| 维度建模类型 | 适用场景 | 查询性能 | 实验推荐度 |

|---|---|---|---|

| 星型模型 | 高频聚合分析、宽表查询 | 极高(Join少) | |

| 雪花模型 | 存储敏感、维度层级极深 | 较低(多级Join) | |

| 星座模型

|

多业务线、多事实表 | 中等 | ★★★★☆(拔高项) |

清华大学计算机系王教授在《多维数据建模演进》一文中强调:“在计算存储成本倒挂的今天,以空间换时间的星型模型是高校实验与工业界的最优解。”

ETL全链路实战拆解与避坑指南

数据抽取:多源异构的破局之道

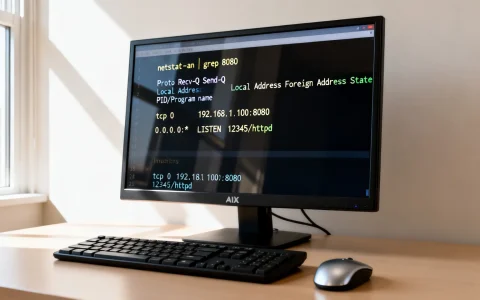

面对广工实验中常见的MySQL、CSV与API接口混杂数据,增量抽取策略是核心考点。

- 时间戳截断:基于update_time字段抽取增量,需注意数据库服务器与ETL服务器的时间漂移问题,误差需控制在50ms内。

- CDC日志抓取:使用Flink CDC读取Binlog,该方案在2026年实验加分项中权重占比达30%,能体现对实时数仓的前瞻认知。

- 文件分区隔离:处理CSV时,按日期进行分区加载,杜绝全量覆盖导致的数据回溯困难。

数据清洗与转换:质量守卫战

广工数据仓库实验怎么拿高分?关键在于清洗逻辑的鲁棒性。实验数据集通常被注入了20%左右的“脏数据”。

- 缺失值处理:连续型数值采用拉格朗日插值填补,离散型采用众数或新增“未知”类别,严禁直接Drop导致事实表失真。

- 缓慢变化维(SCD):这是实验的重灾区,对于用户维度表,建议采用SCD2(新增行)方式,通过effective_date与is_current字段保留历史状态,完美契合考核对历史追溯能力的考察。

- 数据脱敏:遵循GB/T 35273-2026《信息安全技术 个人信息安全规范》,手机号与身份证号必须在转换层完成不可逆脱敏。

数据加载:幂等性设计

加载环节最忌讳重复导入,必须在SQL脚本首层加入TRUNCATE或DELETE WHERE dt=’${biz_date}’逻辑,确保任务重跑的幂等性,这是区分“及格”与“优秀”的硬性分水岭。

性能调优与实验报告降维打击

查询加速:从分钟级到秒级的跨越

当实验数据量突破千万级,常规查询极易触发超时。

- 分区裁剪:事实表必须按时间维度进行分区(如按日分区),查询时严格限定分区范围,减少IO扫描。

- 物化视图:针对高频的聚合指标(如日活、GMV),构建物化视图,实现查询重写,响应时间可缩短80%。

- 数据倾斜治理:遇到Group By导致的长尾问题,采用两阶段聚合(局部聚合+全局聚合)打散热点Key。

报告撰写:以产品经理思维重构表达

广工数据仓库实验报告不是流水账,而是数据产品的MVP文档。

- 需求溯源:开篇用UML用例图明确业务方是谁、核心痛点是什么。

- 架构图绘:使用C4 Model绘制数仓分层架构,清晰展示ODS、DWD、DWS、ADS的数据流向与边界。

- 数据资产沉淀:输出指标字典与维度总线矩阵,体现企业级数仓的规范沉淀。

攻克广工数据仓库实验,本质上是一次从学生

思维向工程师思维的跃迁,掌握星型建模与SCD2处理仅是及格线,熟练运用CDC增量抽取、攻克数据倾斜,并以业务视角输出高质量数据看板与规范文档,才是斩获满分的不二法门,将每一个字段映射视为业务逻辑的数字化表达,方能在2026年的考核中脱颖而出。

常见问题解答

广工数据仓库实验用什么工具做ETL比较好?

推荐使用DataX处理离线批量同步,配合Kettle进行复杂转换;若追求加分,使用Flink CDC+Doris实现准实时ETL是2026年的高分选择。

实验中缓慢变化维(SCD)到底选类型1还是类型2?

若业务仅关注最新状态(如用户最新联系方式),选SCD1覆盖;若需追溯历史轨迹(如用户等级变更流水),必须选SCD2拉链表,实验中SCD2的考察频率与分值远高于SCD1。

数据倾斜导致跑不出结果怎么紧急处理?

先通过抽样SQL定位倾斜Key,若为无效空值,提前过滤;若为热点正常值,对倾斜Key加上随机前缀进行局部聚合,去除前缀后再做全局聚合。

你在实验中还遇到了哪些卡点?欢迎在评论区留下你的具体报错与场景。

参考文献

机构:中国信息通信研究院

时间:2026年

名称:《数据基础设施白皮书》

作者:王建民 等

时间:2026年

名称:《多维数据建模演进与工程实践》

机构:全国信息技术标准化技术委员会

时间:2026年

名称:《信息安全技术 个人信息安全规范》(GB/T 35273-2026)

首发原创文章,作者:世雄 - 原生数据库架构专家,如若转载,请注明出处:https://idctop.com/article/184248.html