构建高效的AI计算平台,核心在于硬件算力与软件生态的精准匹配,对于企业或研究机构而言,服务器搭载深度学习环境的成功与否,直接决定了模型训练的周期与推理的效率,这不仅仅是安装几个库的问题,而是一个涉及硬件选型、系统优化、依赖管理及资源调度的系统工程,只有确保底层硬件与上层软件无缝协同,才能最大化发挥服务器的计算潜能,实现高吞吐量与低延迟的平衡。

硬件架构:算力底座的夯实

硬件是深度学习环境的物理基础,选型必须遵循“算力先行,消除瓶颈”的原则。

-

GPU加速卡的选择

GPU是深度学习的核心引擎,在选型时,显存容量(VRAM)与显存带宽是关键指标。- 大模型训练:建议首选NVIDIA A100或H100系列,80GB高显存能容纳更大的参数模型,减少模型并行带来的通信开销。

- 中小模型与推理:RTX 4090或RTX 6000 Ada系列是性价比之选,具备优秀的单卡算力。

- 多卡互联:必须关注卡间通信带宽,训练环境建议配置NVLink,以实现P2P高速通信,避免受限于PCIe带宽。

-

CPU与PCIe通道的匹配

CPU主要负责数据预处理和任务调度。误区在于过度追求CPU核心数而忽视PCIe通道数。- 通道数:确保CPU提供的PCIe通道数足够支撑所有GPU以x16或x8带宽满血运行,双卡配置至少需要CPU提供32个以上的PCIe 4.0/5.0通道。

- 主频与缓存:深度学习数据加载(如Image解码)对单核主频敏感,建议选择高主频、大L3缓存的处理器。

-

内存与存储子系统

- 内存(RAM):容量应至少为GPU显存总量的2-3倍,4张A100 80GB显卡,建议系统内存配置不低于512GB,以防止数据溢出到磁盘导致训练卡顿。

- 存储(I/O):训练数据的读取速度往往成为瓶颈。必须使用NVMe SSD组建RAID 0或RAID 10阵列,确保读写速度超过3000MB/s,甚至更高,以秒级加载海量小文件数据集。

软件栈构建:驱动与框架的精准对齐

软件环境的稳定性依赖于版本之间的严格兼容性,随意安装版本极易导致“Segmentation Fault”或算力库调用失败。

-

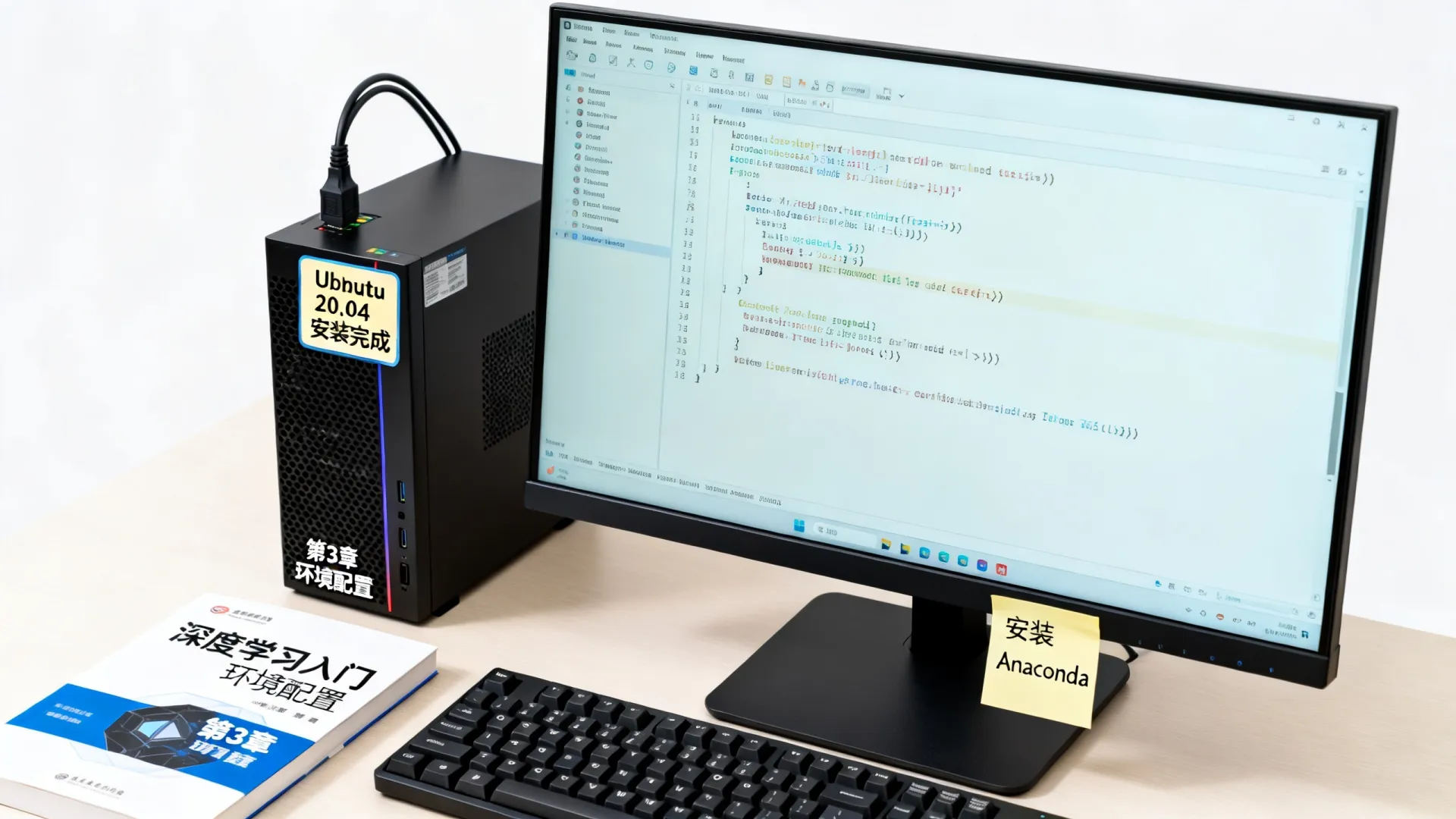

操作系统与内核优化

推荐使用Ubuntu 22.04 LTS LTS版本,其对CUDA和容器技术的支持最为成熟,安装后需进行内核参数调优,如关闭Swap分区、增大最大文件打开数(ulimit)、优化TCP协议栈,以应对高并发网络请求。

-

驱动与CUDA生态

这是环境搭建中最容易出错的环节,遵循“驱动向下兼容,CUDA严格匹配”的原则。- NVIDIA Driver:安装最新的长期支持(LTS)版驱动,确保支持CUDA 12.x及后续版本。

- CUDA Toolkit:不必追求最新,而是根据深度学习框架的要求选择,PyTorch 2.1.x通常对CUDA 11.8或12.1支持最好。

- cuDNN与TensorRT:这两个库是加速推理的关键,必须下载与CUDA版本完全对应的安装包,并正确配置LD_LIBRARY_PATH环境变量。

-

深度学习框架与依赖管理

- Anaconda/Miniconda:强烈建议使用Conda创建虚拟环境,隔离不同项目间的依赖冲突,避免“依赖地狱”。

- PyTorch/TensorFlow:通过官方渠道安装,确保包含CUDA加速的版本,使用

pip install torch --index-url https://download.pytorch.org/whl/cu118此类命令指定源安装,可避免下载到仅支持CPU的版本。

环境隔离与资源调度:生产级解决方案

为了实现多用户共享和资源的高效利用,必须引入容器化和监控技术。

-

容器化部署(Docker & Kubernetes)

直接在宿主机安装环境不仅难以迁移,还存在安全风险。- NVIDIA Container Toolkit:这是让Docker容器能够访问GPU的核心组件。

- 镜像制作:将基础OS、CUDA、PyTorch及常用依赖打包成Docker镜像,实现“一次构建,到处运行”。

- K8s调度:对于大规模集群,使用Kubernetes配合GPU Operator,可以实现基于GPU显存和使用率的智能调度,自动分配任务到空闲节点。

-

实时监控与散热管理

深度学习训练通常是7×24小时运行,硬件稳定性至关重要。- 监控工具:部署Prometheus + Grafana监控套件,实时采集GPU利用率、显存占用、温度及功耗。

- 散热策略:确保服务器机房环境温度适宜,调整服务器风扇策略为“最大性能模式”,防止GPU因过热降频(Throttling),导致训练速度骤降。

独立见解与优化策略

在实际运维中,许多团队容易忽视NUMA(非统一内存访问)架构对性能的影响,在多路CPU服务器上,如果GPU插槽与CPU插槽的物理距离不当,数据跨CPU访问内存会带来巨大延迟,解决方案是使用numactl命令将进程绑定到距离GPU最近的CPU节点上,通常能带来5%-10%的性能提升。

对于服务器搭载深度学习环境的维护,定期进行“算力体检”是必要的,建议编写自动化脚本,每周运行一次微型训练任务,验证矩阵乘法速度和CUDA核函数的正确性,防患于未然。

相关问答

Q1:为什么在深度学习训练中,GPU显存(VRAM)比显存带宽更重要?

A:显存决定了模型和数据能否“装得下”,如果模型参数量或Batch Size超过显存上限,训练程序会直接报错(OOM崩溃),此时无论带宽多快都无法运行,只有在显存充足的前提下,带宽才决定训练速度,显存是门槛,带宽是效率。

Q2:使用Docker容器运行深度学习任务会造成性能损耗吗?

A:损耗极低,通常在2%以内,Docker通过Namespace和Cgroup实现资源隔离,并没有像虚拟机那样进行硬件虚拟化,通过NVIDIA Container Toolkit,容器可以直接调用物理GPU,因此几乎可以接近原生环境的性能,但需要注意存储卷的挂载方式,避免I/O成为瓶颈。

您在配置服务器环境时遇到过哪些棘手的驱动兼容性问题?欢迎在评论区分享您的解决经验。

首发原创文章,作者:世雄 - 原生数据库架构专家,如若转载,请注明出处:https://idctop.com/article/58038.html