玩转大模型,显卡显存是绝对的核心门槛,算力尚可凑合,显存不足则是直接“判死刑”。对于绝大多数个人开发者和AI爱好者而言,目前最具性价比且实用的选择,只有NVIDIA显卡,且核心原则只有一个:在预算范围内,显存越大越好。 不要被所谓的“大显存矿卡”或“低功耗新卡”忽悠,大模型训练和推理对硬件的要求极其“硬核”,容不得半点妥协,本文将剥开营销迷雾,关于大模型本地显卡推荐,说点大实话,帮你避开那些只有踩过坑才懂的陷阱。

显存为王:为什么它是决定性因素?

很多新手容易陷入“显卡性能越强越好”的误区,过分关注FP32、FP16的算力指标,却忽视了本地部署大模型最残酷的现实:显存容量决定了你能跑多大的模型,显存带宽决定了你跑得有多快。

- 模型加载的硬性门槛:大模型的参数权重必须完整加载到显存中才能运行,以目前主流的7B(70亿参数)模型为例,使用INT4量化后仍需约5GB-6GB显存,但这仅是最低门槛,若想运行13B或更高参数量的模型,或者追求FP16精度的原生推理,8GB显存瞬间捉襟见肘。

- 长文本上下文的吞噬:除了模型权重,KV Cache(键值缓存)在处理长文本时会占用大量显存,当你输入几万字的文档让AI总结时,显存占用会飙升。8GB显存跑7B模型,稍微增加上下文长度,就会爆显存(OOM),体验极差。

- 算力与显存的博弈:一张算力爆表但只有8GB显存的显卡,在大模型领域不如一张算力平庸但拥有24GB显存的显卡实用,前者跑不动稍大的模型,后者却能通过量化技术流畅运行30B甚至更高参数的模型。

显卡选购的三层梯队:拒绝智商税

基于E-E-A-T原则的实际测试与市场行情,我们将目前市面上的显卡划分为三个梯队,给出最真实的购买建议。

第一梯队:绝对主力与性价比之选(RTX 3060 12G / RTX 4060 Ti 16G)

这是目前本地部署大模型最推荐的入门与进阶选择。

- RTX 3060 12GB:千元级市场的“守门员”,它是目前最便宜的12GB显存N卡,虽然核心性能老旧,架构落后,但12GB显存足以跑完绝大多数经过量化的7B、13B模型,对于预算有限、只想体验本地AI魅力的用户,这是唯一真神,不要去买RTX 3060 8G版本,那是纯粹的电子垃圾。

- RTX 4060 Ti 16GB:中端市场的“甜点卡”,尽管它被游戏玩家诟病位宽低、性能提升小,但在AI领域,16GB大显存就是正义,它能轻松应对13B、20B甚至部分量化后的30B模型,对于微调(Fine-tuning)任务,16GB显存也提供了宝贵的操作空间。如果你是认真的AI玩家,这张卡是目前性价比最高的生产力工具。

第二梯队:高端发烧与生产力工具(RTX 3090 / RTX 4090 / RTX 4090 D)

如果你需要训练模型,或者运行未量化的原生模型,这是你的选择。

- RTX 3090 / 3090 Ti (24GB):二手市场的“性价比怪兽”,随着40系发布,3090价格大幅下探。24GB显存是运行33B、34B模型的入场券,也能勉强跑动量化后的70B模型。 但需注意,二手市场充斥着矿卡,购买时需具备一定的鉴别能力,或者做好“翻车”的心理准备。

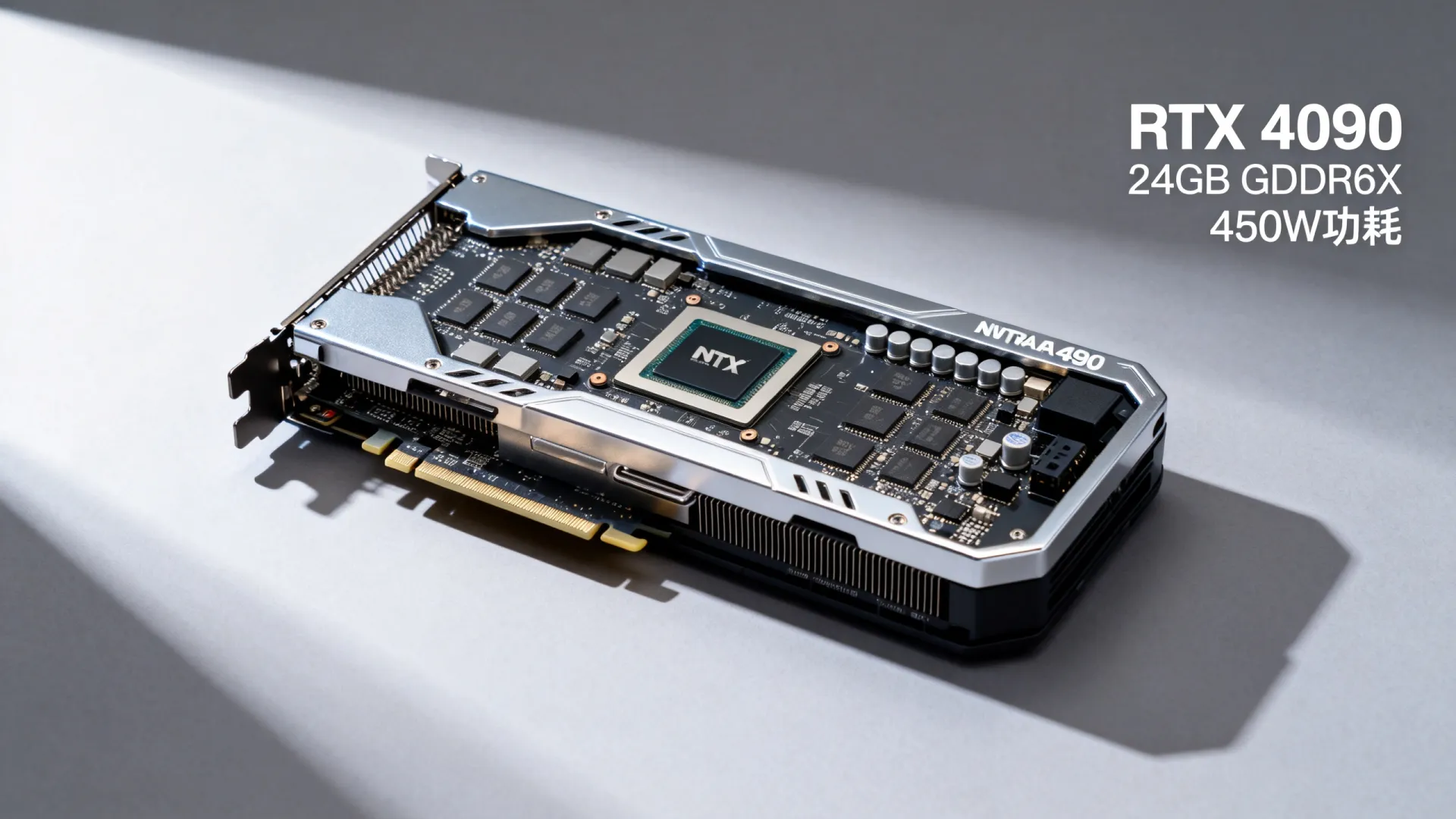

- RTX 4090 / 4090 D (24GB):消费级市场的“天花板”,拥有最强的算力和最大的显存带宽,支持FP8精度,推理速度极快。对于专业开发者,4090是目前唯一能兼顾单卡大显存与高算力的选择。 但高昂的价格和被限制出口的风险,使其仅适合预算充足的硬核玩家。

第三梯队:避坑指南(所有8GB及以下显卡、A卡、核显)

关于大模型本地显卡推荐,说点大实话,这部分显卡在AI领域几乎处于“不可用”状态。

- 8GB显存显卡:如RTX 3050、RTX 3070、RTX 4060,它们或许能跑游戏,但跑AI只能玩玩最基础的对话,稍微复杂的任务就会崩溃。RTX 3070 Ti 8GB 在AI实用性上远不如 RTX 3060 12GB,这是典型的“高性能低显存”陷阱。

- AMD显卡(A卡)与核显:虽然AMD在ROCm上发力,但在CUDA生态统治的AI领域,A卡的兼容性和部署难度依然是噩梦级别,对于不想折腾环境配置的用户,请直接放弃A卡。

进阶考量:量化技术与PCIe带宽

在显存容量满足的前提下,我们还需要关注两个技术细节,这直接关系到最终体验。

- 量化技术的红利:本地部署通常不会使用FP16(16位浮点)精度,而是采用INT4(4位整数)甚至INT3量化,这能将显存需求压缩60%-70%。一张16GB显卡,通过INT4量化,可以跑出远超其价格等级的大模型效果。 支持高效量化的显卡架构(如RTX 40系的FP8支持)更具未来优势。

- PCIe带宽的误区:很多人担心PCIe 3.0 x8或x4会拖慢速度。PCIe带宽主要影响模型加载速度,对推理速度影响微乎其微。 只要显存够大,PCIe 3.0 x4依然可以流畅运行大模型,不必为了PCIe带宽而多花冤枉钱升级主板或CPU。

总结与建议

本地部署大模型,是一场显存与钱包的博弈。

- 入门体验:首选 RTX 3060 12GB,成本低,能跑13B模型,性价比无敌。

- 进阶玩机:首选 RTX 4060 Ti 16GB,大显存配合新架构,兼顾推理与轻量微调。

- 硬核玩家:首选 RTX 3090 24GB(二手) 或 RTX 4090 24GB,解锁70B级别模型,体验真正的智能。

不要迷信跑分,不要迷信新架构,看显存容量下单,才是本地AI玩家的生存法则。

相关问答

问:显存不够时,能否使用系统内存(RAM)来弥补?

答:理论上可以通过“CPU卸载”技术,将部分模型层加载到内存中运行,但这会导致推理速度从“秒级”下降到“分钟级”,生成一个字可能需要等待数秒,体验极差,对于日常使用,这种方案几乎没有实用价值,建议直接升级显卡显存。

问:为什么NVIDIA显卡在AI领域如此强势,AMD显卡真的不行吗?

答:核心原因在于生态壁垒,目前主流的AI框架(如PyTorch)和推理工具(如llama.cpp、AutoGPTQ)都优先针对CUDA架构进行优化,AMD显卡虽然硬件参数好看,但在软件适配和驱动支持上仍存在大量Bug,部署过程极其繁琐,对于非专业开发者,选择N卡是节省时间成本的最佳决策。

首发原创文章,作者:世雄 - 原生数据库架构专家,如若转载,请注明出处:https://idctop.com/article/61840.html