AI人工智能服务器是支撑现代数字化转型的核心算力基础设施,其通过高性能硬件架构与智能软件生态的深度融合,为深度学习模型训练、推理及大规模数据处理提供确定性保障,区别于通用服务器,AI服务器在计算密度、能效比及扩展性方面具有显著优势,是企业构建人工智能竞争力的关键底座。

核心价值:算力决定AI落地边界

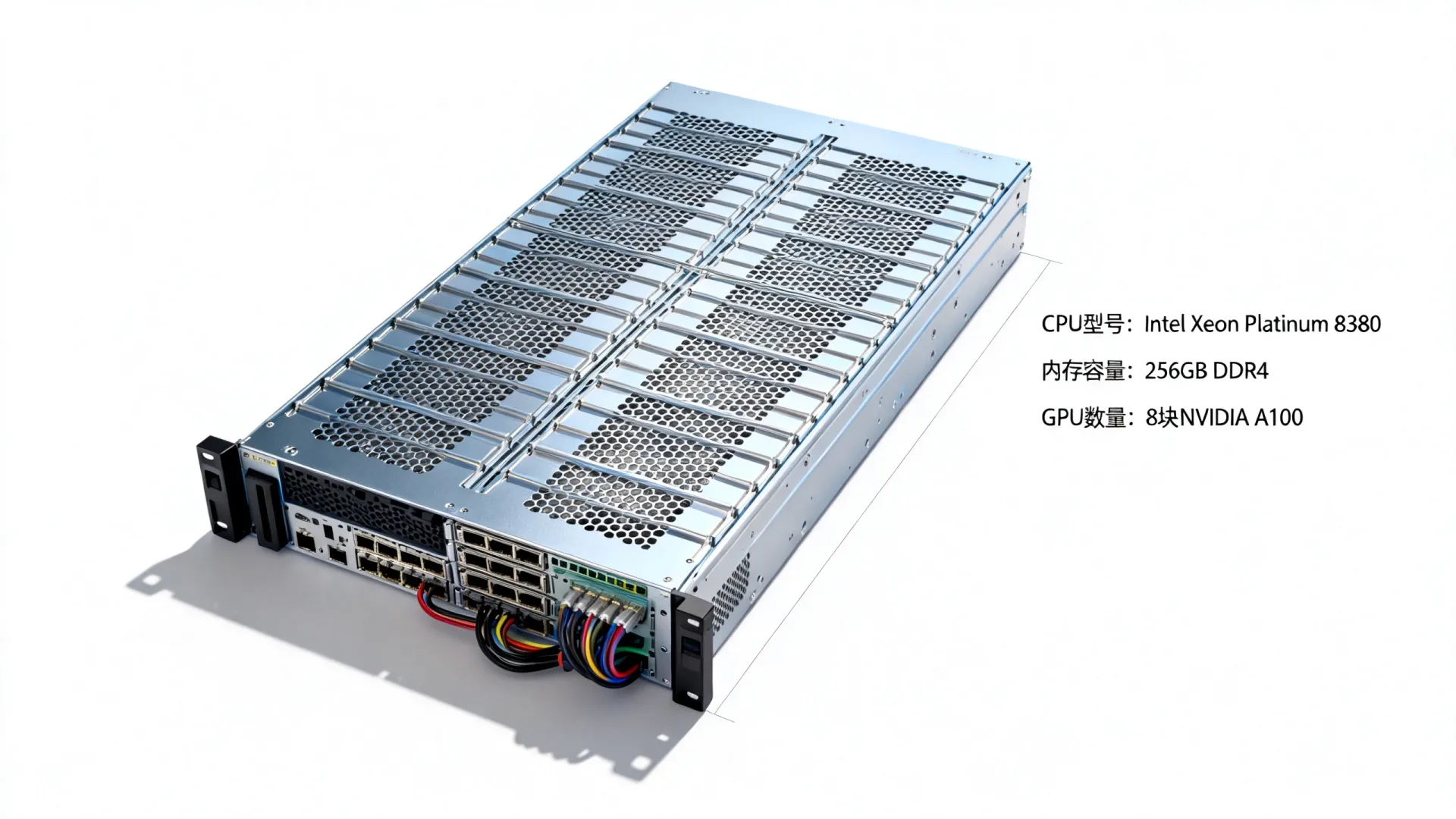

AI服务器的本质是解决算力供需矛盾,随着大模型参数量突破千亿级别,传统CPU架构已无法满足矩阵运算需求,而AI服务器通过搭载GPU、TPU或专用加速芯片,实现并行计算效率的数量级提升,单台配置8张高性能GPU的AI服务器,其浮点运算能力可达传统服务器的100倍以上,同时通过NVLink等互联技术降低数据传输延迟,这种算力跃升直接决定了企业能否在合理时间内完成模型迭代,进而影响业务决策效率。

硬件架构:三大核心组件解析

-

计算单元

- 主流方案采用异构计算架构,CPU负责逻辑控制,GPU/加速卡承担核心计算任务

- 最新一代AI服务器支持多芯片互联,例如NVIDIA H100采用NVLink 4.0技术,实现900GB/s的显存带宽

- 部分厂商推出存算一体架构,将计算单元嵌入存储模块,减少数据搬运能耗

-

存储系统

- 分级存储设计:DDR5内存提供低延迟临时存储,NVMe SSD保障高速数据吞吐

- 典型配置建议:每TFLOPS算力需匹配4-8GB显存容量,避免成为性能瓶颈

- 新兴技术如CXL内存扩展,可动态调配存储资源

-

散热方案

- 风冷系统适用于中小规模部署,PUE值通常在1.5以上

- 液冷方案(冷板式/浸没式)可将PUE降至1.1以下,单机柜功率密度提升300%

- 智能温控系统通过实时监测芯片温度,动态调整风扇转速或流量

软件生态:从硬件到生产力的转化

硬件性能的释放依赖软件栈优化,成熟的AI服务器需具备:

- 算力调度平台:支持Kubernetes容器化部署,实现资源利用率最大化

- 框架适配层:预装TensorFlow、PyTorch等主流框架,并提供算子加速库

- 监控运维系统:实时追踪GPU利用率、显存占用等20+项指标,预测性维护

选型策略:四维度评估模型

企业部署AI服务器时,建议从以下维度建立评估体系:

- 算力匹配度:根据模型参数量选择FP16/FP32精度下的理论峰值

- 扩展灵活性:支持横向扩展(Scale-out)与纵向升级(Scale-up)

- TCO控制:综合硬件采购成本、电力消耗及运维人力投入

- 生态兼容性:验证与现有IT基础设施、开发工具链的适配情况

行业应用:差异化场景实践

金融领域:高频交易系统采用低延迟AI服务器,端到端响应时间控制在微秒级

医疗影像:配置大显存GPU的服务器处理3D医学图像,单次推理耗时缩短至200ms内

自动驾驶:边缘AI服务器需满足-40℃~85℃工作温度,抗震动设计保障车载可靠性

相关问答

Q:AI服务器与普通服务器的主要区别是什么?

A:核心差异体现在三方面:计算架构上采用异构加速芯片而非纯CPU;存储系统针对大模型优化带宽与容量;散热设计应对高功耗挑战,部分型号支持液冷方案。

Q:中小企业如何选择AI服务器配置?

A:建议采用阶梯式策略:初期选择2-4卡入门级机型验证业务模型;中期扩展至8卡服务器集群;后期根据模型复杂度评估是否需要定制化硬件方案,重点关注显存容量与互联带宽指标。

您在部署AI服务器过程中遇到过哪些具体挑战?欢迎分享实际应用场景与解决方案。

首发原创文章,作者:世雄 - 原生数据库架构专家,如若转载,请注明出处:https://idctop.com/article/61936.html